在官网使用AI总是服务器繁忙?不想内容被撤回?使用API调用LLM可以基本解决上述问题,还能接入更多MCP服务器,让AI更加强大。

获取API Key

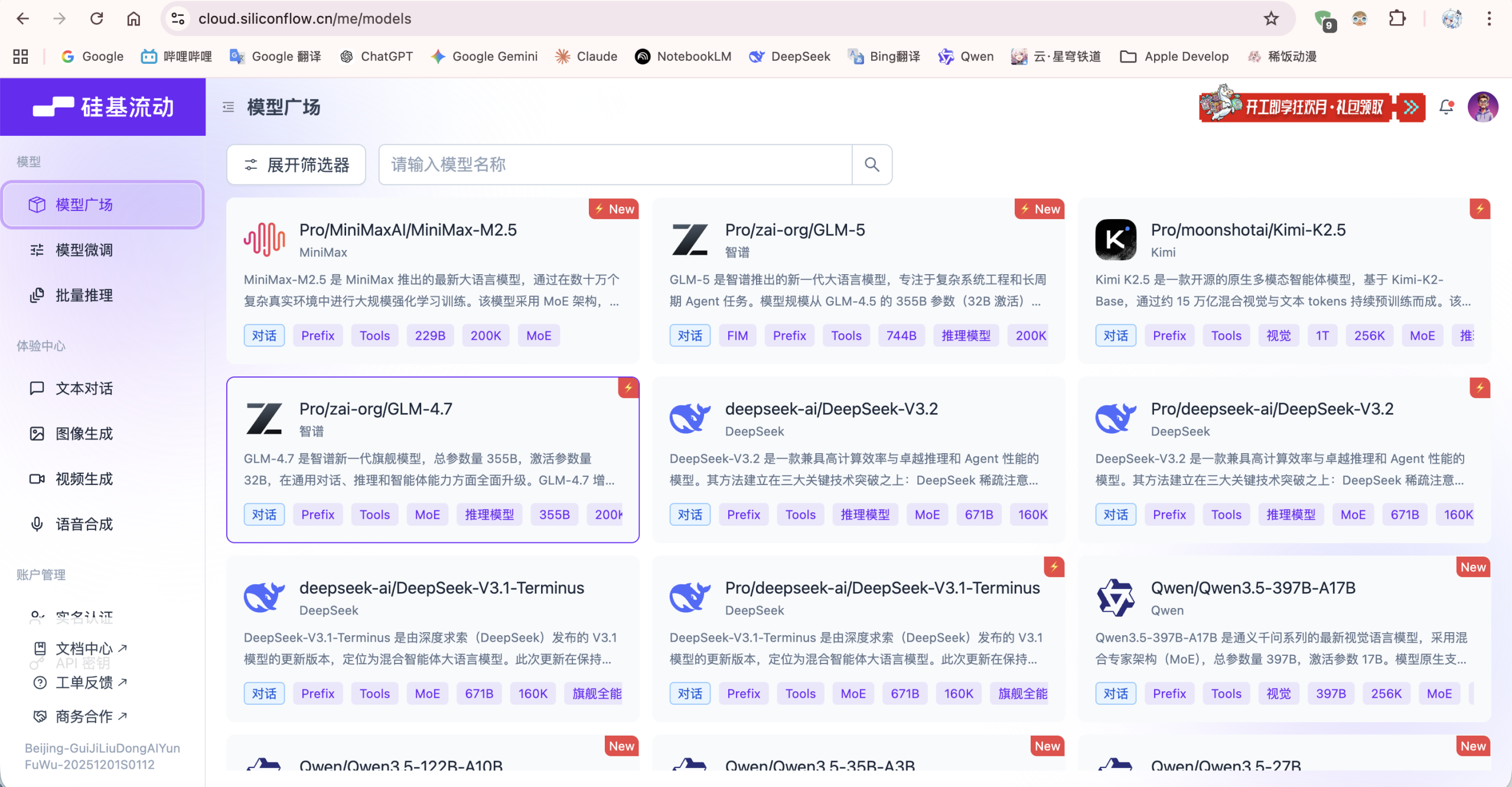

你可以在SiliconFlow上注册账号,进入如下界面

向下滑动左侧导航栏,找到「实名认证」,并按照提示完成实名认证

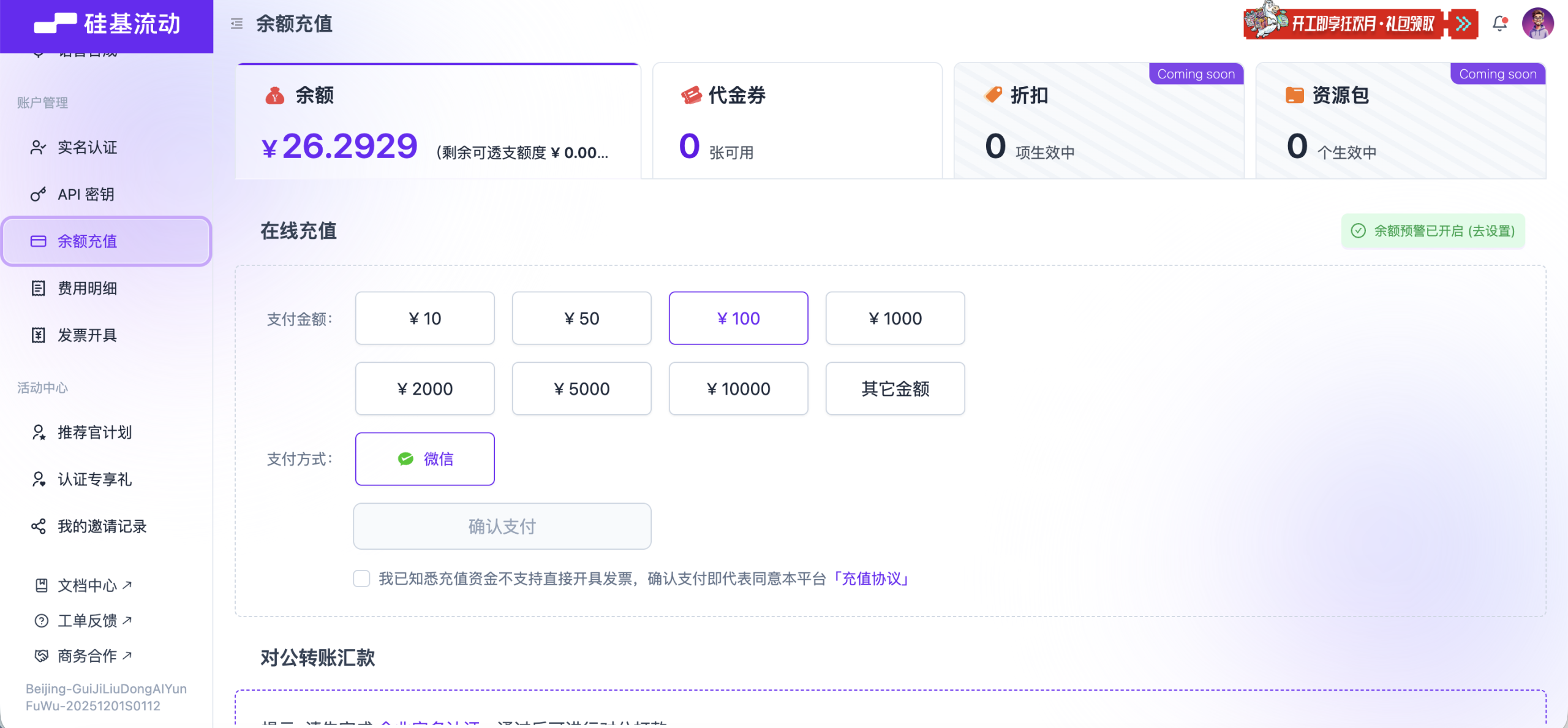

完成后在左侧导航栏找到「余额充值」,根据需要充值金额。

充值后,选择左侧的API密钥

点击「新建API密钥」,自行保管好自己的API密钥,避免泄漏。

使用LLM客户端

在本文中,我们用Cherry Studio作为例子,点击这里进入Cherry Studio官网

点击「下载」,下载安装文件,并完成安装。

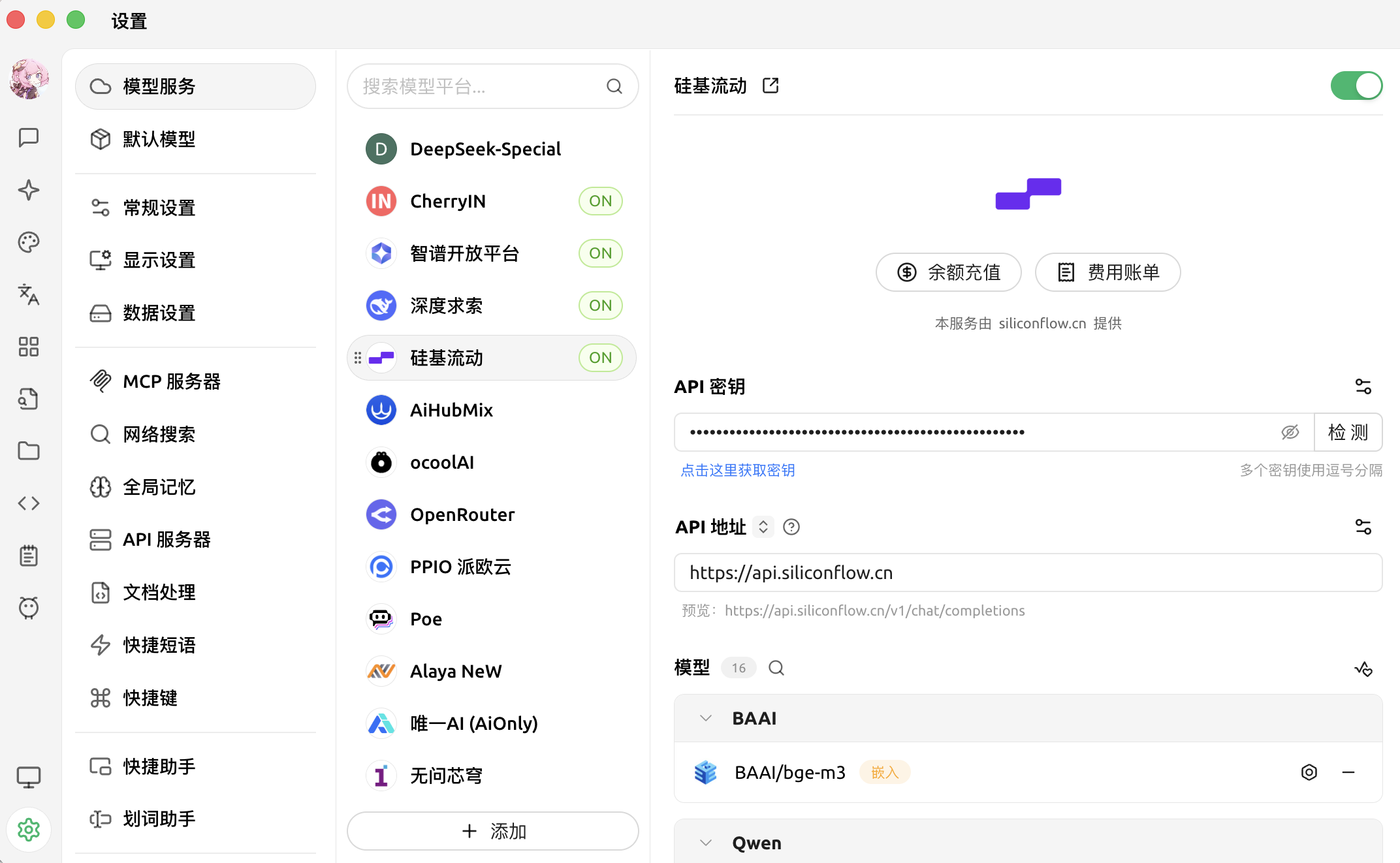

打开Cherry Studio,选择左边导航栏最下方的设置,进入「模型服务」设置。

点击「硅基流动」,粘贴你的API Key到API密钥栏中,点击「检测」,随便选择一个模型进行测试,待测试成功后进行下一步

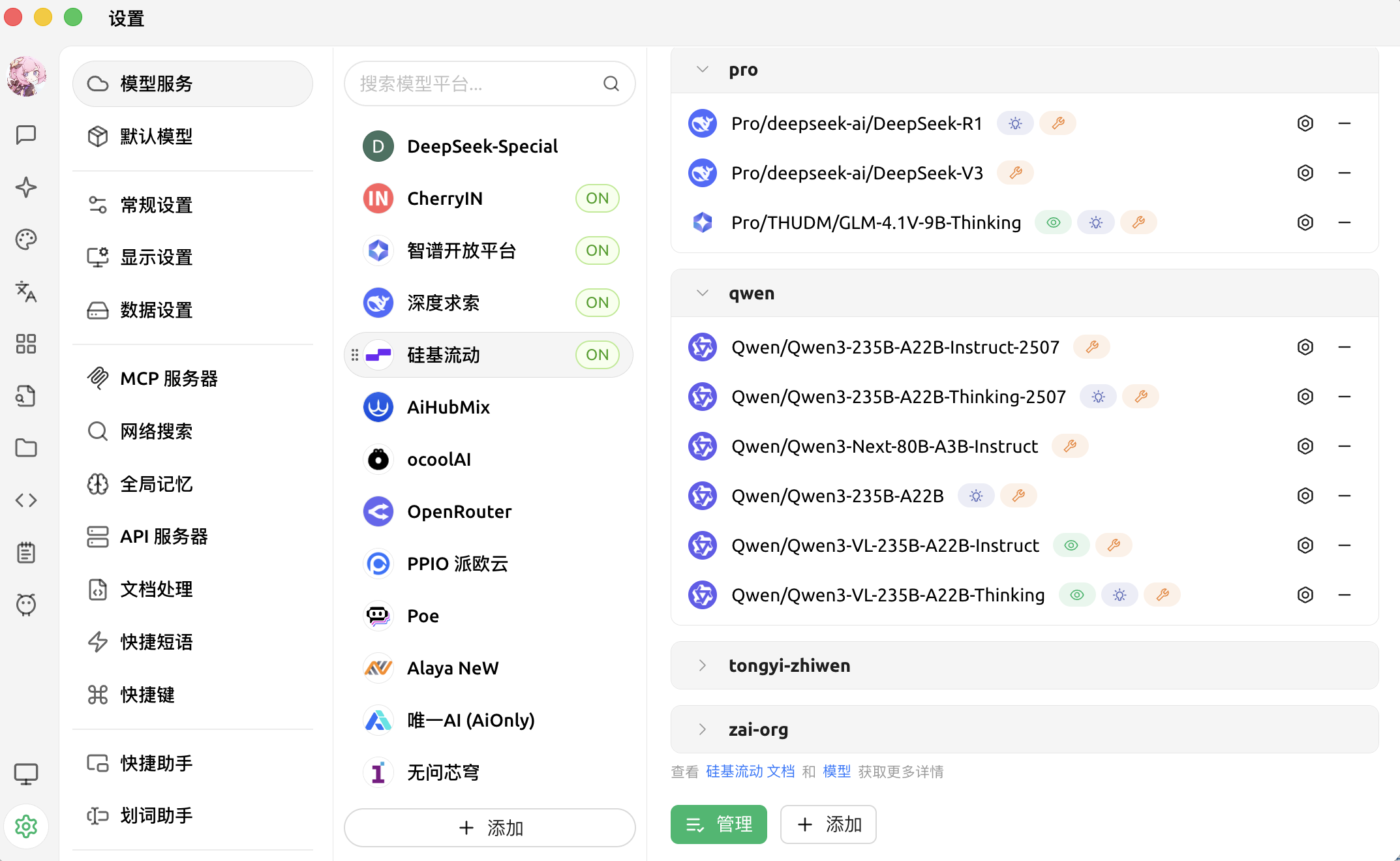

滚动到这个页面的最下方,点击「管理」

来到如下页面

点击搜索栏最右侧的「刷新」按钮,以获取完整的模型列表

完成后在下方选择你想要使用的模型,点击模型右侧的「+」号,完成后关闭这个页面

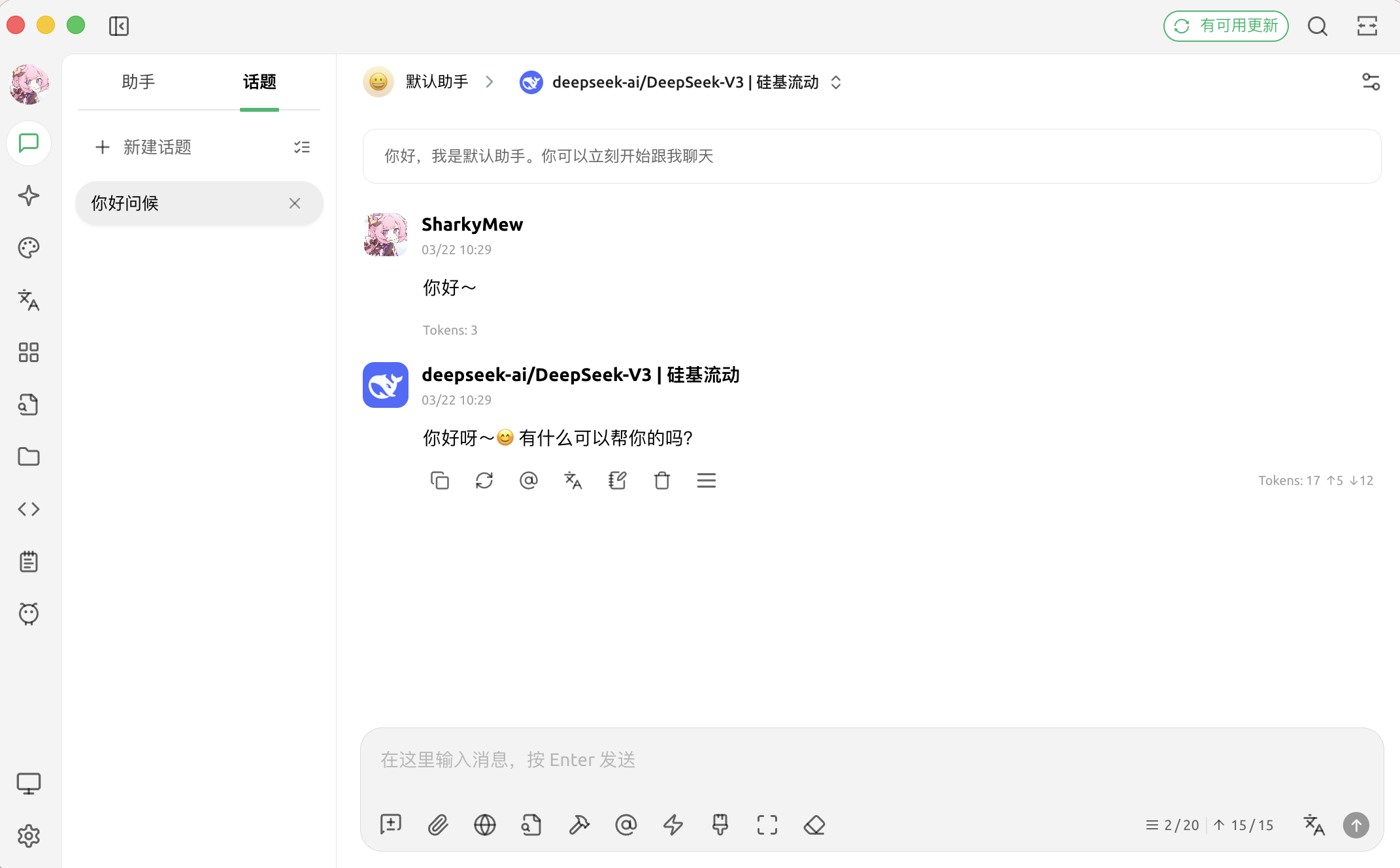

选择左侧导航栏中的对话气泡,来到对话页面,点击「话题」进入聊天界面,并尝试对话,若前面的配置没有问题,这里应当一切正常

总结

本文介绍了如何配置LLM API Key,以在LLM客户端中使用API提供商的模型,减少不必要的中断。